ICML 2019的錄取結(jié)果昨天已經(jīng)出爐,許多投稿者在Twitter發(fā)表“中了”的消息,新智元摘選了幾篇不錯的ICML中獎?wù)撐模↖an Goodfellow等人的論文,一起來先睹為快吧!

昨天,ICML 2019的論文入選結(jié)果已經(jīng)出爐,你的論文中了嗎?

來自Reddit的討論貼

盡管完整錄取列表尚未公開,不過已經(jīng)有許多投稿者在Twitter發(fā)表“中了”的消息。

下面,新智元摘選了幾篇不錯的ICML中獎?wù)撐模黄饋硐榷脼榭彀伞?/p>

5篇ICML 2019論文推薦

首先介紹來自加州大學(xué)圣地亞哥分校Yao Qin、Garrison Cottrell和前谷歌大腦Ian Goodfellow等人的論文,在這篇論文中,研究人員提出了語音識別的對抗樣本。

1、Imperceptible, Robust, and Targeted Adversarial Examples for Automatic Speech Recognition

https://arxiv.org/abs/1903.10346

作者:Yao Qin, Nicholas Carlini, Ian Goodfellow, Garrison Cottrell, Colin Raffel

對抗樣本(adversarial examples)是一種專門設(shè)計的輸入,其目的是使機器學(xué)習(xí)模型產(chǎn)生錯誤的輸出。

對抗樣本在圖像領(lǐng)域已經(jīng)得到了廣泛的研究。在圖像領(lǐng)域中,可以通過對圖像進行細(xì)微的修改來產(chǎn)生對抗樣本,從而導(dǎo)致分類錯誤,這在物理世界中具有實用價值。

但是,目前應(yīng)用于語音識別系統(tǒng)的有針對性的對抗樣本卻缺乏這兩種特性:人類可以很容易地識別對抗性干擾,并在通過揚聲器播放時它們并不生效。

本研究在這兩個方面都取得了進展。首先,我們利用聽覺掩碼(auditory masking)的心理聲學(xué)原理,在人類聽不到的音頻區(qū)域添加對抗擾動,開發(fā)出有效的、不易察覺的音頻對抗樣本(通過人類研究得到驗證),同時對任意完整的句子保持100%的針對性成功率。

接下來,我們通過構(gòu)造在應(yīng)用于真實的模擬環(huán)境扭曲后仍然有效的擾動,從而在物理世界的無線音頻對抗樣本方面取得了進展。

2、TensorFuzz: Debugging Neural Networks with Coverage-Guided Fuzzing

https://arxiv.org/abs/1807.10875

作者:Augustus Odena, Ian Goodfellow

眾所周知,由于各種原因,機器學(xué)習(xí)模型難以調(diào)試(debug)或解釋。這造成了最近機器學(xué)習(xí)的 “可重復(fù)性危機”(reproducibility crisis)—— 對難以調(diào)試的技術(shù)做出可靠的實驗結(jié)論是很棘手的。

神經(jīng)網(wǎng)絡(luò)又特別難以 debug,因為即使是相對直接的關(guān)于神經(jīng)網(wǎng)絡(luò)的形式問題,解決的計算成本也很高,而且神經(jīng)網(wǎng)絡(luò)的軟件實現(xiàn)可能與理論模型有很大的差異。

在這項工作中,我們利用傳統(tǒng)軟件工程中的一種技術(shù) —— 覆蓋引導(dǎo)模糊測試(coverage guided fuzzing,CGF),并將其應(yīng)用于神經(jīng)網(wǎng)絡(luò)的測試。

具體來說,這項工作有以下貢獻:

我們對神經(jīng)網(wǎng)絡(luò)引入了 CGF 的概念,并描述了如何用快速近似最近鄰算法( fast approximate nearest neighbors algorithms)以通用的方式檢查覆蓋率。

我們開源了一個名為 TensorFuzz 的 CGF 軟件庫。

我們使用 TensorFuzz 在已訓(xùn)練的神經(jīng)網(wǎng)絡(luò)中查找數(shù)值問題,在神經(jīng)網(wǎng)絡(luò)及其量化版本之間查找分歧,以及在字符級語言模型中查找不良行為。

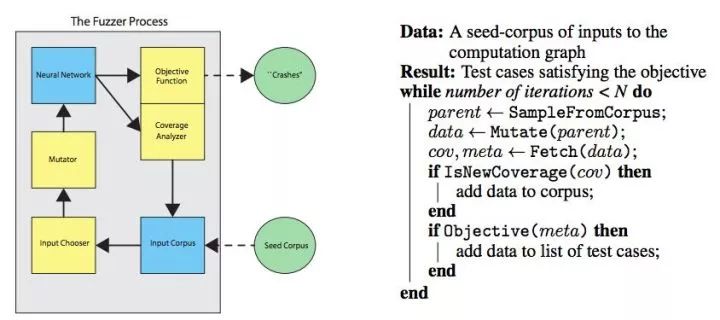

圖:fuzzing 主循環(huán)的簡略描述。左:模糊測試程序圖,表示數(shù)據(jù)的 flow。右:用算法的形式描述了模糊測試過程的主循環(huán)。

相關(guān)閱讀:

谷歌大腦開源 TensorFuzz,自動 Debug 神經(jīng)網(wǎng)絡(luò)!

接下來介紹的論文來自羅格斯大學(xué)Han Zhang和Dimitris Metaxas,以及谷歌大腦的 Ian Goodfellow 和 Augustus Odena,在這篇論文中,他們提出“自注意力生成對抗網(wǎng)絡(luò)”(SAGAN),將自注意力機制(self-attention mechanism)引入到卷積 GAN 中,作為卷積的補充,取得了最優(yōu)的結(jié)果。

3、Self-Attention Generative Adversarial Networks

arxiv.org/abs/1805.08318

作者:Han Zhang, Ian Goodfellow, Dimitris Metaxas, Augustus Odena

在這篇論文中,我們提出自注意力生成對抗網(wǎng)絡(luò)( Self-Attention Generative Adversarial Network ,SAGAN)。SAGAN 允許對圖像生成任務(wù)進行注意力驅(qū)動、長相關(guān)性的建模。傳統(tǒng)的卷積 GAN 生成的高分辨率細(xì)節(jié)僅作為在低分辨率特征圖上的空間局部點的函數(shù)。在 SAGAN 中,可以使用來自所有特征位置的線索來生成細(xì)節(jié)。此外,鑒別器可以檢查圖像的遠(yuǎn)端部分的高度詳細(xì)的特征彼此一致。此外,最近的研究表明,生成器條件會影響 GAN 的性能。

利用這些發(fā)現(xiàn),我們將譜歸一化到 GAN 生成器中,并發(fā)現(xiàn)這改進了訓(xùn)練動態(tài)。我們提出的 SAGAN 達到了最優(yōu)的結(jié)果,將 Inception score 從當(dāng)前最高的 36.8 提高到 52.52,并且在具有挑戰(zhàn)性的 ImageNet 數(shù)據(jù)集上將 Frechet Inception distance 從 27.62 降低到 18.65。注意力層的可視化表明,生成器利用與對象形狀相對應(yīng)的鄰域,而不是固定形狀的局部區(qū)域。

相關(guān)閱讀:

Ian Goodfellow 等提出自注意力 GAN,ImageNet 圖像合成獲最優(yōu)結(jié)果!

接下來推薦的論文來自東京大學(xué)的Kenta Oono和Taiji Suzuki,這篇論文有41頁,對于會議論文來說確實有點長。

4、Approximation and Non-parametric Estimation of ResNet-type Convolutional Neural Networks

arxiv.org/abs/1903.10047

作者:Kenta Oono, Taiji Suzuki

卷積神經(jīng)網(wǎng)絡(luò)(CNNs)在多個函數(shù)類中均能達到最優(yōu)逼近和估計誤差率(在minimax意義上)。然而,由于包括Holder類在內(nèi)的重要函數(shù)類的稀疏約束,以往分析的最優(yōu)CNN的范圍過于廣泛,難以通過優(yōu)化獲得。

我們證明了一個ResNet類型的CNN可以在更合理的情況下在這些類別中獲得minimax最優(yōu)錯誤率——它可以是密集的,它的寬度、通道大小和過濾器大小相對于樣本大小是恒定的。

其核心思想是,只要神經(jīng)網(wǎng)絡(luò)具有 extit{block-sparse}結(jié)構(gòu),我們就可以通過定制的CNN來復(fù)制全連接神經(jīng)網(wǎng)絡(luò)(FNN)的學(xué)習(xí)能力。從某種意義上說,我們的理論是通用的,我們可以自動地將block-sparse FNN所實現(xiàn)的任何近似率轉(zhuǎn)換成CNN的近似率。作為應(yīng)用,我們使用相同策略推導(dǎo)出針對Barron類和H?lder類的CNN的近似誤差和估計誤差。

5、Imitation Learning from Imperfect Demonstration

https://arxiv.org/abs/1901.09387

作者:Yueh-Hua Wu, Nontawat Charoenphakdee, Han Bao, Voot Tangkaratt, Masashi Sugiyama

模仿學(xué)習(xí)(Imitation learning, IL)的目的是通過演示學(xué)習(xí)最優(yōu)策略。然而,由于收集最優(yōu)示例的成本很高,因此此類演示通常并不完美。為了有效地從不完美的演示中學(xué)習(xí),我們提出了一種新的方法,利用置信評分(confidence scores)來描述演示的質(zhì)量。更具體地說,我們提出了兩種基于confidence的IL方法,即兩步的重要性加權(quán)IL (2IWIL)和具有不完美演示和置信度的生成對抗性IL (IC-GAIL)。我們證明了,僅給出一小部分次優(yōu)演示的置信度得分在理論上和經(jīng)驗上都顯著提高了 IL 的性能。

更多ICML 2019錄取論文

1、Heterogeneous Model Reuse via Optimizing Multiparty Multiclass Margin

作者:吳西竹,周志華,柳松

2、Importance Sampling Policy Evaluation with an Estimated Behavior Policy

arxiv.org/abs/1806.01347

作者:Josiah Hanna, Scott Niekum, Peter Stone

3、Extrapolating Beyond Suboptimal Demonstrations via Inverse Reinforcement Learning from Observations

arxiv.org/abs/1904.06387

作者:Daniel S. Brown, Wonjoon Goo, Prabhat Nagarajan, Scott Niekum

4、Global Convergence of Block Coordinate Descent in Deep Learning

arxiv.org/abs/1803.00225

作者:Jinshan Zeng, Tim Tsz-Kit Lau, Shaobo Lin, Yuan Yao

5、Learn-to-Grow for addressing Catastrophic Forgetting in Continual Machine Learning

https://arxiv.org/abs/1904.00310

作者:Xilai Li, Yingbo Zhou, Tianfu Wu, Richard Socher, Caiming Xiong

6、Imitating Latent Policies from Observation

https://arxiv.org/abs/1805.07914

Ashley D. Edwards,Himanshu Sahni,Yannick Schroecker,Charles L. Isbell

7、Using Pre-Training Can Improve Model Robustness and Uncertainty

arxiv.org/abs/1901.09960

作者:Dan Hendrycks, Kimin Lee, Mantas Mazeika

8、Hyperbolic Disk Embeddings for Directed Acyclic Graphs

arxiv.org/abs/1902.04335

作者:Ryota Suzuki, Ryusuke Takahama, Shun Onoda

9、Finding Options that Minimize Planning Time

arxiv.org/abs/1810.07311

作者:Yuu Jinnai, David Abel, D Ellis Hershkowitz, Michael Littman, George Konidaris

10、Discovering Options for Exploration by Minimizing Cover Time

https://arxiv.org/abs/1903.00606

作者:Yuu Jinnai, Jee Won Park, David Abel, George Konidaris

-

神經(jīng)網(wǎng)絡(luò)

+關(guān)注

關(guān)注

42文章

4814瀏覽量

103658 -

語音識別

+關(guān)注

關(guān)注

39文章

1782瀏覽量

114249 -

論文

+關(guān)注

關(guān)注

1文章

103瀏覽量

15223

原文標(biāo)題:ICML 2019錄取結(jié)果出爐,Ian Goodfellow等入選論文推薦

文章出處:【微信號:AI_era,微信公眾號:新智元】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

格靈深瞳六篇論文入選ICCV 2025

理想汽車八篇論文入選ICCV 2025

思必馳與上海交大聯(lián)合實驗室兩篇論文入選ICML 2025

基于STM32藍(lán)牙控制小車系統(tǒng)設(shè)計(硬件+源代碼+論文)下載

基于STM32的智能水產(chǎn)養(yǎng)殖系統(tǒng)電路+代碼+論文實例打包下載

后摩智能四篇論文入選三大國際頂會

STM32+Android實現(xiàn)的智能家政機器人電路代碼論文及項目源碼

云知聲四篇論文入選自然語言處理頂會ACL 2025

老板必修課:如何用NotebookLM 在上下班路上吃透一篇科技論文?

美報告:中國芯片研究論文全球領(lǐng)先

后摩智能5篇論文入選國際頂會

OpenHarmony程序分析框架論文入選ICSE 2025

ICML 2019的論文入選結(jié)果已經(jīng)出爐,你的論文中了嗎?

ICML 2019的論文入選結(jié)果已經(jīng)出爐,你的論文中了嗎?

評論