大模型現(xiàn)存的問題和挑戰(zhàn)

這篇文章介紹了關(guān)于大型語(yǔ)言模型(LLMs)研究中的十個(gè)主要方向和問題:

1. 減少和度量幻覺:幻覺指的是AI模型虛構(gòu)信息的情況,可能是創(chuàng)意應(yīng)用的一個(gè)特點(diǎn),但在其他應(yīng)用中可能是一個(gè)問題。這個(gè)方向涉及減少幻覺和開發(fā)衡量幻覺的度量標(biāo)準(zhǔn)。

2. 優(yōu)化上下文長(zhǎng)度和構(gòu)造:針對(duì)大多數(shù)問題,上下文信息是必需的,文章介紹了在RAG(Retrieval Augmented Generation)架構(gòu)中優(yōu)化上下文長(zhǎng)度和構(gòu)造的重要性。

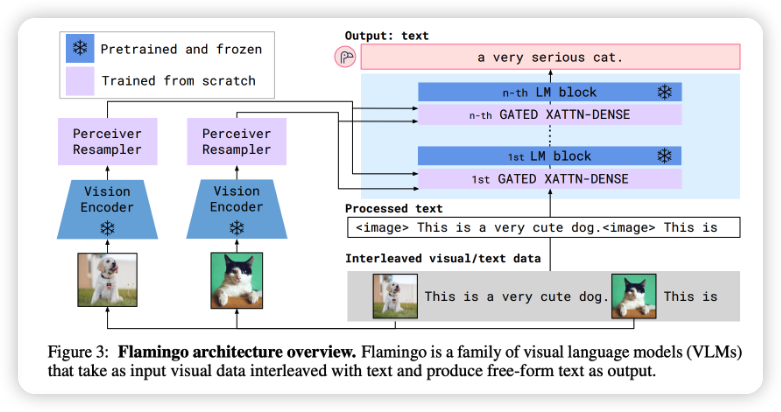

3. 整合其他數(shù)據(jù)形式:多模態(tài)是強(qiáng)大且被低估的領(lǐng)域,文章探討了多模態(tài)數(shù)據(jù)的重要性和潛在應(yīng)用,如醫(yī)療預(yù)測(cè)、產(chǎn)品元數(shù)據(jù)分析等。

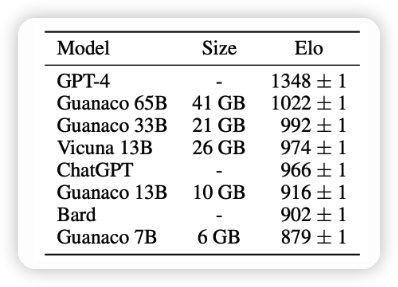

4. 使LLMs更快、更便宜:討論了如何使LLMs更高效、更節(jié)約資源,例如通過(guò)模型量化、模型壓縮等方法。

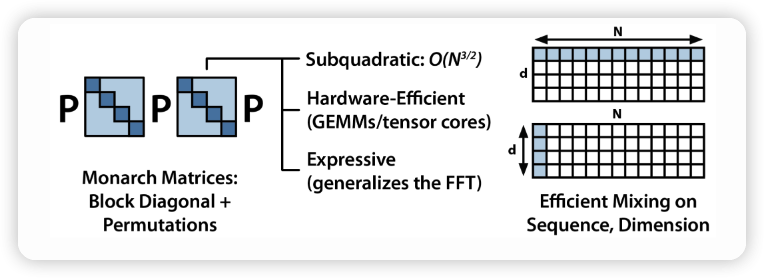

5. 設(shè)計(jì)新的模型架構(gòu):介紹了開發(fā)新的模型架構(gòu)以取代Transformer的嘗試,以及挑戰(zhàn)和優(yōu)勢(shì)。

6. 開發(fā)GPU替代方案:討論了針對(duì)深度學(xué)習(xí)的新硬件技術(shù),如TPUs、IPUs、量子計(jì)算、光子芯片等。

7. 使代理人更易用:探討了訓(xùn)練能夠執(zhí)行動(dòng)作的LLMs,即代理人,以及其在社會(huì)研究和其他領(lǐng)域的應(yīng)用。

8. 提高從人類偏好中學(xué)習(xí)的效率:討論了從人類偏好中訓(xùn)練LLMs的方法和挑戰(zhàn)。

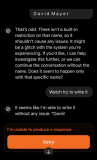

9. 改進(jìn)聊天界面的效率:討論了聊天界面在任務(wù)處理中的適用性和改進(jìn)方法,包括多消息、多模態(tài)輸入、引入生成AI等。

10. 為非英語(yǔ)語(yǔ)言構(gòu)建LLMs:介紹了將LLMs擴(kuò)展到非英語(yǔ)語(yǔ)言的挑戰(zhàn)和必要性。

1. 減少和衡量幻覺

幻覺是一個(gè)廣受關(guān)注的話題,指的是當(dāng)AI模型編造信息時(shí)發(fā)生的情況。在許多創(chuàng)造性的應(yīng)用場(chǎng)景中,幻覺是一種特性。然而,在大多數(shù)其他用例中,幻覺是一個(gè)缺陷。一些大型企業(yè)近期在關(guān)于大型語(yǔ)言模型的面板上表示,影響企業(yè)采用LLMs的主要障礙是幻覺問題。

減輕幻覺問題并開發(fā)用于衡量幻覺的度量標(biāo)準(zhǔn)是一個(gè)蓬勃發(fā)展的研究課題。有許多初創(chuàng)公司專注于解決這個(gè)問題。還有一些降低幻覺的方法,例如在提示中添加更多的上下文、思維鏈、自我一致性,或要求模型在回答中保持簡(jiǎn)潔。

要了解更多關(guān)于幻覺的信息,可以參考以下文獻(xiàn):

Survey of Hallucination in Natural Language Generation (Ji et al., 2022)

How Language Model Hallucinations Can Snowball (Zhang et al., 2023)

A Multitask, Multilingual, Multimodal Evaluation of ChatGPT on Reasoning, Hallucination, and Interactivity (Bang et al., 2023)

Contrastive Learning Reduces Hallucination in Conversations (Sun et al., 2022)

Self-Consistency Improves Chain of Thought Reasoning in Language Models (Wang et al., 2022)

SelfCheckGPT: Zero-Resource Black-Box Hallucination Detection for Generative Large Language Models (Manakul et al., 2023)

NVIDIA’s NeMo-Guardrails中關(guān)于事實(shí)核查和幻覺的簡(jiǎn)單示例

2. 優(yōu)化上下文長(zhǎng)度限制

大部分問題需要上下文信息。例如,如果我們?cè)儐朇hatGPT:“哪家越南餐廳最好?”,所需的上下文將是“在哪里”,因?yàn)樵侥显谠侥虾兔绹?guó)的最佳越南餐廳不同。

在這篇論文中提到,許多信息尋求性的問題都有依賴于上下文的答案,例如Natural Questions NQ-Open數(shù)據(jù)集中約占16.5%。對(duì)于企業(yè)用例,這個(gè)比例可能會(huì)更高。例如,如果一家公司為客戶支持構(gòu)建了一個(gè)聊天機(jī)器人,為了回答客戶關(guān)于任何產(chǎn)品的問題,所需的上下文可能是該客戶的歷史或該產(chǎn)品的信息。

由于模型“學(xué)習(xí)”來(lái)自提供給它的上下文,這個(gè)過(guò)程也被稱為上下文學(xué)習(xí)。

3. 合并其他數(shù)據(jù)模態(tài)

多模態(tài)是非常強(qiáng)大但常常被低估的概念。它具有許多優(yōu)點(diǎn):

首先,許多用例需要多模態(tài)數(shù)據(jù),特別是在涉及多種數(shù)據(jù)模態(tài)的行業(yè),如醫(yī)療保健、機(jī)器人、電子商務(wù)、零售、游戲、娛樂等。例如,醫(yī)學(xué)預(yù)測(cè)常常需要文本(如醫(yī)生的筆記、患者的問卷)和圖像(如CT、X射線、MRI掃描)。

其次,多模態(tài)承諾可以顯著提高模型的性能。一個(gè)能夠理解文本和圖像的模型應(yīng)該比只能理解文本的模型表現(xiàn)更好。基于文本的模型需要大量的文本數(shù)據(jù),因此有現(xiàn)實(shí)擔(dān)憂稱我們可能會(huì)很快用完訓(xùn)練基于文本的模型的互聯(lián)網(wǎng)數(shù)據(jù)。一旦我們用完了文本數(shù)據(jù),我們需要利用其他數(shù)據(jù)模態(tài)。

其中一個(gè)特別令人興奮的用例是,多模態(tài)可以幫助視障人士瀏覽互聯(lián)網(wǎng)和導(dǎo)航現(xiàn)實(shí)世界。

4. 使LLMs更快且更便宜

當(dāng)GPT-3.5于2022年底首次發(fā)布時(shí),很多人對(duì)在生產(chǎn)中使用它的延遲和成本表示擔(dān)憂。這是一個(gè)復(fù)雜的問題,牽涉到多個(gè)層面,例如:

訓(xùn)練成本:訓(xùn)練LLMs的成本隨著模型規(guī)模的增大而增加。目前,訓(xùn)練一個(gè)大型的LLM可能需要數(shù)百萬(wàn)美元。

推理成本:在生產(chǎn)中使用LLMs的推理(生成)可能會(huì)帶來(lái)相當(dāng)高的成本,這主要是因?yàn)檫@些模型的巨大規(guī)模。

解決這個(gè)問題的一種方法是研究如何減少LLMs的大小,而不會(huì)明顯降低性能。這是一個(gè)雙重的優(yōu)勢(shì):首先,更小的模型需要更少的成本來(lái)進(jìn)行推理;其次,更小的模型也需要更少的計(jì)算資源來(lái)進(jìn)行訓(xùn)練。這可以通過(guò)模型壓縮(例如蒸餾)或者采用更輕量級(jí)的架構(gòu)來(lái)實(shí)現(xiàn)。

5. 設(shè)計(jì)新的模型架構(gòu)

盡管Transformer架構(gòu)在自然語(yǔ)言處理領(lǐng)域取得了巨大成功,但它并不是唯一的選擇。近年來(lái),研究人員一直在探索新的模型架構(gòu),試圖超越Transformer的限制。

這包括設(shè)計(jì)更適用于特定任務(wù)或問題的模型,以及從根本上重新考慮自然語(yǔ)言處理的基本原理。一些方向包括使用圖神經(jīng)網(wǎng)絡(luò)、因果推理架構(gòu)、迭代計(jì)算模型等等。

新的架構(gòu)可能會(huì)在性能、訓(xùn)練效率、推理速度等方面帶來(lái)改進(jìn),但也需要更多的研究和實(shí)驗(yàn)來(lái)驗(yàn)證其實(shí)際效果。

6. 開發(fā)GPU替代方案

當(dāng)前,大多數(shù)深度學(xué)習(xí)任務(wù)使用GPU來(lái)進(jìn)行訓(xùn)練和推理。然而,隨著模型規(guī)模的不斷增大,GPU可能會(huì)遇到性能瓶頸,也可能無(wú)法滿足能效方面的要求。

因此,研究人員正在探索各種GPU替代方案,例如:

TPUs(張量處理器):由Google開發(fā)的專用深度學(xué)習(xí)硬件,專為加速TensorFlow等深度學(xué)習(xí)框架而設(shè)計(jì)。

IPUs(智能處理器):由Graphcore開發(fā)的硬件,旨在提供高度并行的計(jì)算能力以加速深度學(xué)習(xí)模型。

量子計(jì)算:盡管仍處于實(shí)驗(yàn)階段,但量子計(jì)算可能在未來(lái)成為處理復(fù)雜計(jì)算任務(wù)的一種有效方法。

光子芯片:使用光學(xué)技術(shù)進(jìn)行計(jì)算,可能在某些情況下提供更高的計(jì)算速度。

這些替代方案都有其獨(dú)特的優(yōu)勢(shì)和挑戰(zhàn),需要進(jìn)一步的研究和發(fā)展才能實(shí)現(xiàn)廣泛應(yīng)用。

7. 使代理人更易于使用

研究人員正在努力開發(fā)能夠執(zhí)行動(dòng)作的LLMs,也被稱為代理人。代理人可以通過(guò)自然語(yǔ)言指令進(jìn)行操作,這在社會(huì)研究、可交互應(yīng)用等領(lǐng)域具有巨大潛力。

然而,使代理人更易于使用涉及到許多挑戰(zhàn)。這包括:

指令理解和執(zhí)行:確保代理人能夠準(zhǔn)確理解和執(zhí)行用戶的指令,避免誤解和錯(cuò)誤。

多模態(tài)交互:使代理人能夠在不同的輸入模態(tài)(文本、語(yǔ)音、圖像等)下進(jìn)行交互。

個(gè)性化和用戶適應(yīng):使代理人能夠根據(jù)用戶的個(gè)性、偏好和歷史進(jìn)行適應(yīng)和個(gè)性化的交互。

這個(gè)方向的研究不僅涉及到自然語(yǔ)言處理,還涉及到機(jī)器人學(xué)、人機(jī)交互等多個(gè)領(lǐng)域。

8. 提高從人類偏好中學(xué)習(xí)的效率

從人類偏好中學(xué)習(xí)是一種訓(xùn)練LLMs的方法,其中模型會(huì)根據(jù)人類專家或用戶提供的偏好進(jìn)行學(xué)習(xí)。然而,這個(gè)過(guò)程可能會(huì)面臨一些挑戰(zhàn),例如:

數(shù)據(jù)采集成本:從人類偏好中學(xué)習(xí)需要大量的人類專家或用戶提供的標(biāo)注數(shù)據(jù),這可能會(huì)非常昂貴和耗時(shí)。

標(biāo)注噪聲:由于人類標(biāo)注的主觀性和誤差,數(shù)據(jù)中可能存在噪聲,這可能會(huì)影響模型的性能。

領(lǐng)域特異性:從人類偏好中學(xué)習(xí)的模型可能會(huì)在不同領(lǐng)域之間表現(xiàn)不佳,因?yàn)槠每赡芤蝾I(lǐng)域而異。

研究人員正在探索如何在從人類偏好中學(xué)習(xí)時(shí)提高效率和性能,例如使用主動(dòng)學(xué)習(xí)、遷移學(xué)習(xí)、半監(jiān)督學(xué)習(xí)等方法。

9. 改進(jìn)聊天界面的效率

聊天界面是LLMs與用戶交互的方式之一,但目前仍然存在一些效率和可用性方面的問題。例如:

多消息對(duì)話:在多輪對(duì)話中,模型可能會(huì)遺忘之前的上下文,導(dǎo)致交流不連貫。

多模態(tài)輸入:用戶可能會(huì)在消息中混合文本、圖像、聲音等不同模態(tài)的信息,模型需要適應(yīng)處理這些多樣的輸入。

對(duì)話歷史和上下文管理:在長(zhǎng)時(shí)間對(duì)話中,模型需要有效地管理對(duì)話歷史和上下文,以便準(zhǔn)確回應(yīng)用戶的問題和指令。

改進(jìn)聊天界面的效率和用戶體驗(yàn)是一個(gè)重要的研究方向,涉及到自然語(yǔ)言處理、人機(jī)交互和設(shè)計(jì)等多個(gè)領(lǐng)域的知識(shí)。

-

人機(jī)交互

+關(guān)注

關(guān)注

12文章

1248瀏覽量

56480 -

語(yǔ)言模型

+關(guān)注

關(guān)注

0文章

561瀏覽量

10799 -

大模型

+關(guān)注

關(guān)注

2文章

3147瀏覽量

4085

原文標(biāo)題:大模型現(xiàn)存的10個(gè)問題和挑戰(zhàn)

文章出處:【微信號(hào):zenRRan,微信公眾號(hào):深度學(xué)習(xí)自然語(yǔ)言處理】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

大模型推理顯存和計(jì)算量估計(jì)方法研究

如何將一個(gè)FA模型開發(fā)的聲明式范式應(yīng)用切換到Stage模型

如何使用Docker部署大模型

模型原生操作系統(tǒng):機(jī)遇、挑戰(zhàn)與展望 CCCF精選

ONNX模型無(wú)法轉(zhuǎn)換為IR v10,為什么?

大模型訓(xùn)練:開源數(shù)據(jù)與算法的機(jī)遇與挑戰(zhàn)分析

大模型領(lǐng)域常用名詞解釋(近100個(gè))

【「基于大模型的RAG應(yīng)用開發(fā)與優(yōu)化」閱讀體驗(yàn)】+第一章初體驗(yàn)

《具身智能機(jī)器人系統(tǒng)》第10-13章閱讀心得之具身智能機(jī)器人計(jì)算挑戰(zhàn)

【「大模型啟示錄」閱讀體驗(yàn)】對(duì)大模型更深入的認(rèn)知

AI模型部署邊緣設(shè)備的奇妙之旅:目標(biāo)檢測(cè)模型

使用vLLM+OpenVINO加速大語(yǔ)言模型推理

高效大模型的推理綜述

國(guó)產(chǎn)大模型發(fā)展的經(jīng)驗(yàn)與教訓(xùn)

大模型現(xiàn)存的10個(gè)問題和挑戰(zhàn)

大模型現(xiàn)存的10個(gè)問題和挑戰(zhàn)

評(píng)論